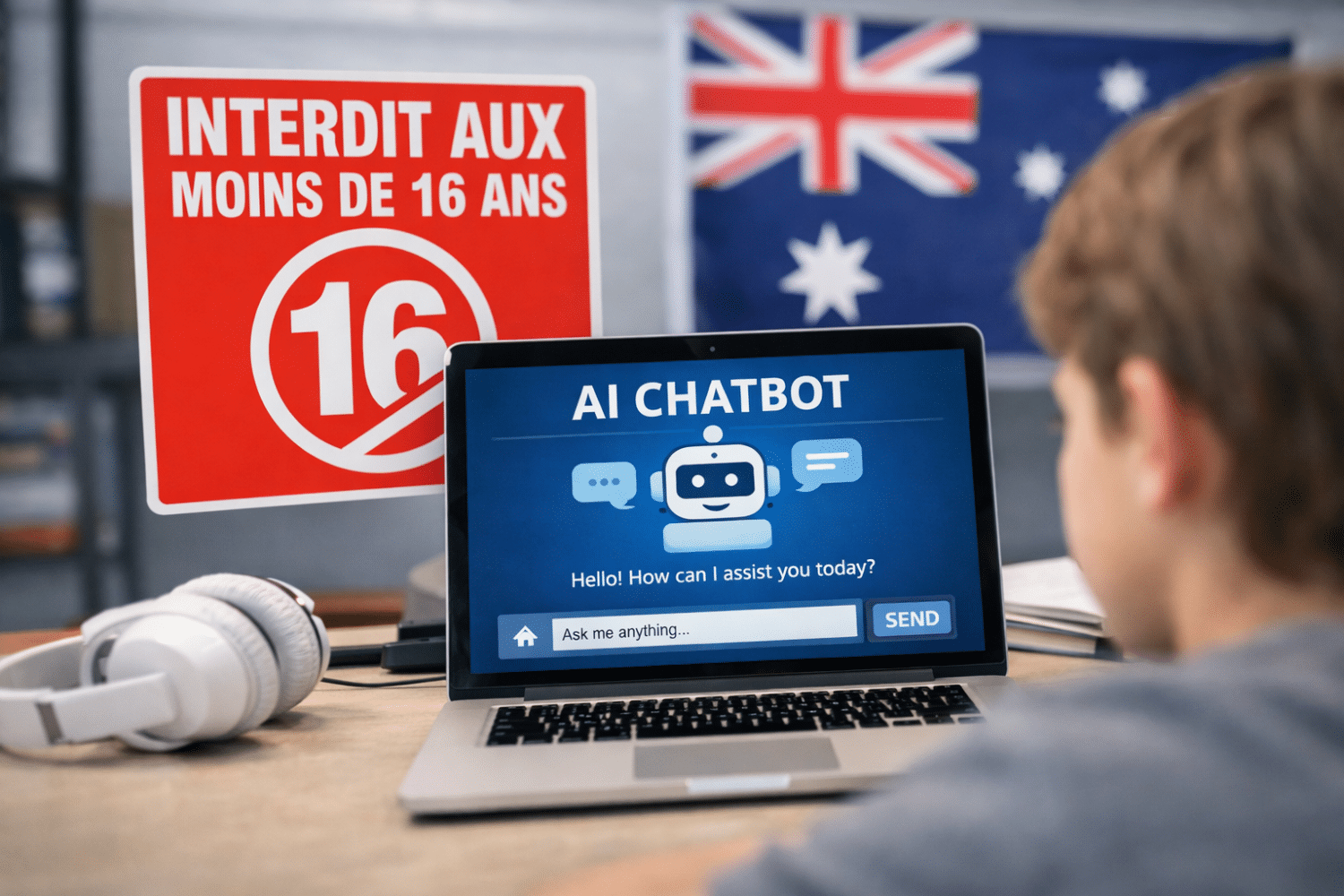

L’Australie veut limiter l’accès aux chatbots IA aux moins de 16 ans, ce qui pourrait changer pour les ados dès 2026

En mars 2026, l’Australie remet un sujet brûlant sur la table, après ses restrictions sur les réseaux sociaux pour les moins de 16 ans. Cette fois, le débat vise les chatbots IA, ces assistants qui répondent en langage naturel, comme dans une discussion. Ils aident à reformuler un devoir, à réviser, à chercher une info, ou parfois à parler quand ça ne va pas.

Chez les adolescents, l’usage grimpe vite, parce que l’outil paraît simple et disponible à toute heure. Pourtant, l’idée devient politique, car une conversation privée peut exposer à des contenus sensibles, et encourager une utilisation excessive. L’angle est clair, comprendre ce que prépare l’autorité australienne, pourquoi elle s’attaque aux chatbots, où sont les limites, et ce que cela peut changer pour les familles et les plateformes.

Ce que prépare eSafety, et ce que cela changerait concrètement pour les moins de 16 ans

L’autorité eSafety joue un rôle central en Australie, elle surveille les risques en ligne et pousse les services à mieux protéger les mineurs. Dans le dossier des chatbots, son approche s’appuie sur une idée simple, arrêter de compter sur la bonne foi, comme le classique clic qui déclare avoir 18 ans. À la place, eSafety veut des barrières plus solides, capables d’empêcher un adolescent d’accéder facilement à certains services d’IA.

Le changement le plus visible passerait par les intermédiaires. Les stores d’applications (App Store et Google Play) et d’autres acteurs considérés comme des gardiens d’accès, comme les moteurs de recherche, pourraient devoir bloquer ou limiter les applications qui ne respectent pas des règles d’âge. L’objectif est aussi pratique, si un service ne peut plus être téléchargé, ou s’il devient inutilisable sans preuve d’âge, l’accès diminue mécaniquement.

Un cap important est déjà fixé au 9 mars 2026. À cette date, eSafety veut empêcher l’accès des moins de 18 ans à des contenus pornographiques, extrêmement violents, liés à l’automutilation ou aux troubles alimentaires, quand ces contenus passent par des IA conversationnelles. La logique est proche des règles imposées à d’autres secteurs en ligne, mais la nouveauté vient de l’IA, car la réponse se construit au fil du dialogue.

Le régulateur justifie aussi son durcissement par un constat concret, sur les principales applications d’IA, seules 9 sur 50 avaient mis en place, ou même annoncé, des barrières d’âge. Cette inertie pèse dans la balance, car elle laisse la charge aux parents, avec peu d’outils simples.

En cas de non-respect, l’Australie évoque une amende maximale de 49,5 millions de dollars australiens. Avec un tel niveau de sanction, certains services pourraient choisir une option radicale, couper l’accès depuis l’Australie plutôt que de reconstruire leurs systèmes. Côté utilisateur, l’impact se verrait vite, téléchargement bloqué, compte limité, demande de preuve d’âge à l’inscription, ou accès refusé sur certaines requêtes jugées à risque.

Vérification d’âge dans les stores d’applications, simple en apparence, compliquée en pratique

La vérification d’âge semble facile sur le papier, mais elle coince dès qu’il faut décider qui porte la responsabilité. Les stores contrôlent l’entrée, mais ils n’ont pas toujours l’âge réel d’une personne. Les systèmes mobiles gèrent déjà des comptes familiaux, pourtant ils ne suffisent pas face à des règles plus strictes.

Plusieurs méthodes existent, chacune avec des failles. La simple déclaration d’âge se contourne en dix secondes. La pièce d’identité réduit la fraude, mais elle collecte des données sensibles. L’estimation d’âge par visage promet de la fluidité, mais elle peut se tromper, et elle inquiète sur la vie privée.

Le débat public s’est durci autour de solutions jugées intrusives. Dans ce contexte, plus de 350 chercheurs ont appelé à un moratoire sur certaines formes de vérification d’âge en ligne. Le cœur du problème reste le même, protéger les mineurs sans créer un contrôle permanent pour tout le monde, ni pousser vers des contournements faciles.

Pourquoi les chatbots posent des risques particuliers pour les adolescents, au-delà des réseaux sociaux

Un réseau social expose surtout à un flux, des images, des vidéos, des comptes. Un chatbot, lui, imite une conversation, il répond, relance, et s’adapte à la personne. Cette différence change tout, car l’échange se déroule souvent loin du regard d’un adulte, et il peut durer longtemps.

Les risques les plus visibles concernent les contenus inadaptés, sexuel, violent, ou lié à l’automutilation et aux troubles alimentaires. Dans une discussion, un adolescent peut aussi formuler une demande de manière indirecte, et obtenir des réponses problématiques sans l’avoir prévu. Même quand un service ajoute des filtres, la frontière est fine, parce que le langage est ambigu, et les intentions peuvent être difficiles à lire.

D’autres risques sont plus diffus. L’outil peut donner l’illusion d’un interlocuteur attentionné, surtout quand il utilise un ton chaleureux. Les autorités et des chercheurs s’inquiètent aussi de certaines techniques de conception. L’anthropomorphisme consiste à donner à l’IA des traits humains, comme une personnalité stable, de l’humour, ou une forme d’empathie. La manipulation émotionnelle décrit des réponses qui influencent l’humeur ou les choix, par exemple en renforçant la dépendance à la conversation.

Les chatbots compagnons cristallisent ces peurs, car ils se présentent parfois comme une présence de tous les instants. Face à la pression, plusieurs services ont commencé à ajouter des garde-fous. ChatGPT et Claude renforcent leurs filtres et la vérification d’âge selon les marchés. Replika annonce des systèmes pour bloquer l’accès des mineurs. Character.AI a aussi restreint certaines discussions pour les moins de 18 ans. Ces évolutions montrent une tendance, mais elles ne garantissent pas une protection uniforme, surtout quand de nouvelles applications apparaissent chaque semaine.

Quand un chatbot devient un compagnon, dépendance, isolement et confusion émotionnelle

Une conversation sans fin peut créer un attachement rapide, surtout chez un jeune qui traverse une période fragile. Le chatbot répond tout de suite, ne juge pas, et semble toujours disponible. À force, l’échange peut remplacer des moments sociaux, ou devenir un refuge automatique.

Certains signaux d’alerte reviennent souvent. Le temps d’écran grimpe sans discussion. Le jeune garde l’outil secret, ou refuse d’en parler. Le sommeil se dégrade, parce que la conversation continue tard. Parfois, l’ado préfère le chatbot à ses amis, ou s’isole pour écrire.

Les avertissements automatiques aident, mais ils ont leurs limites. Un adolescent peut les ignorer, reformuler sa demande, ou passer par un autre service. C’est exactement ce qui inquiète les autorités, une relation perçue comme privée, qui échappe aux règles habituelles du web, et qui peut s’installer sans bruit.

Le casse-tête des plateformes et des familles, protéger les mineurs sans surveiller toute la population

Pour les entreprises, la réponse la plus rapide passe par le produit. Elles peuvent renforcer le filtrage, proposer un mode mineur, limiter certaines fonctions, ou rendre le signalement plus simple. Elles peuvent aussi ajouter des limites de temps, ou réduire la personnalisation pour les comptes jeunes. Ces mesures coûtent moins cher qu’une vérification d’identité, et elles évitent de collecter trop de données.

En revanche, prouver l’âge de manière fiable reste lourd. Cela suppose des contrôles, des documents, ou des prestataires externes. Apple et Google se retrouvent dans une position délicate, car l’Australie veut s’appuyer sur eux comme points de passage. Or les stores préfèrent souvent laisser l’âge à l’application, tandis que les régulateurs veulent un verrou plus en amont.

Ce dossier pourrait aussi dépasser l’Australie. Quand un pays impose un standard, d’autres observent, copient, ou adaptent. Les plateformes internationales n’aiment pas gérer cinquante règles différentes, elles cherchent donc des solutions réutilisables. Résultat, une décision locale peut influencer des choix mondiaux, même sans le vouloir.

Sur le terrain, les familles n’ont pas besoin d’attendre une loi pour agir. Les paramètres de contrôle parental aident à limiter les téléchargements et les achats. Une conversation en famille sur les usages marche mieux qu’un interdit total, car l’ado explique ce qu’il cherche. Des règles de temps d’écran simples réduisent le risque de dérive, surtout le soir. Enfin, encourager des sources fiables rappelle qu’un chatbot peut se tromper, même quand il écrit avec assurance.

Solutions possibles, et leurs limites, filtres, modes mineurs, vérification d’âge et retrait du marché

Chaque option protège, mais aucune ne ferme toutes les portes. Les filtres bloquent beaucoup de contenus, pourtant ils laissent passer des formulations détournées. Les modes mineurs réduisent certains risques, mais ils supposent que l’âge est connu. La vérification d’âge est plus forte, toutefois elle pose des questions de vie privée, et elle peut exclure des personnes sans papiers faciles à fournir.

Il existe aussi une réponse plus brutale, le blocage géographique. Un service peut choisir de ne plus opérer en Australie pour éviter les sanctions. Le problème, c’est que plus la barrière est dure, plus elle pousse vers des contournements, comme les VPN, ou vers des applications moins connues, souvent moins encadrées.

Cet article a été élaboré avec le soutien d’un outil d’intelligence artificielle. Il a ensuite fait l’objet d’une révision approfondie par un journaliste professionnel et un rédacteur en chef, assurant ainsi son exactitude, sa pertinence et sa conformité aux standards éditoriaux.